Nvidia

Signs: una plataforma impulsada por IA para el aprendizaje de la lengua de señas

( Services )

- Experiencia del Cliente

- Tecnología y Datos

El desafío

Para 11 millones de personas sordas y con dificultades auditivas en los EE. UU., el acceso a una comunicación eficaz es un desafío diario. Y para lxs niñxs sordxs, lo que está en juego es aún mayor. El 90% tiene padres oyentes que pueden tener poca o ninguna experiencia con la lengua de señas. Sin una exposición temprana al American Sign Language (ASL), estxs niñxs corren el riesgo de privación del lenguaje, una condición que puede afectar el desarrollo cognitivo, la educación y el bienestar emocional.

Pero aprender ASL por tu cuenta siempre ha sido difícil. Si bien hay profesorxs increíbles, programas de ASL y escuelas que ofrecen instrucción, muchas personas no tienen acceso a ellos. Las clases tradicionales de ASL pueden ser costosas y geográficamente limitadas. Existen tutoriales en video, pero carecen de lo que más necesitan lxs estudiantes: feedback. No te dicen cuándo la posición de tu mano está ligeramente desviada. No te ayudan a ajustar tus movimientos en tiempo real. No te responden.

La educación en ASL necesitaba una revolución, una que pudiera hacer que el aprendizaje fuera más interactivo, más accesible y más inmediato. Una que pudiera empoderar a lxs estudiantes, cerrar la brecha entre las comunidades sordas y oyentes, y hacer que dominar el ASL fuera más intuitivo para cualquiera, en cualquier lugar.

La solución – Signs

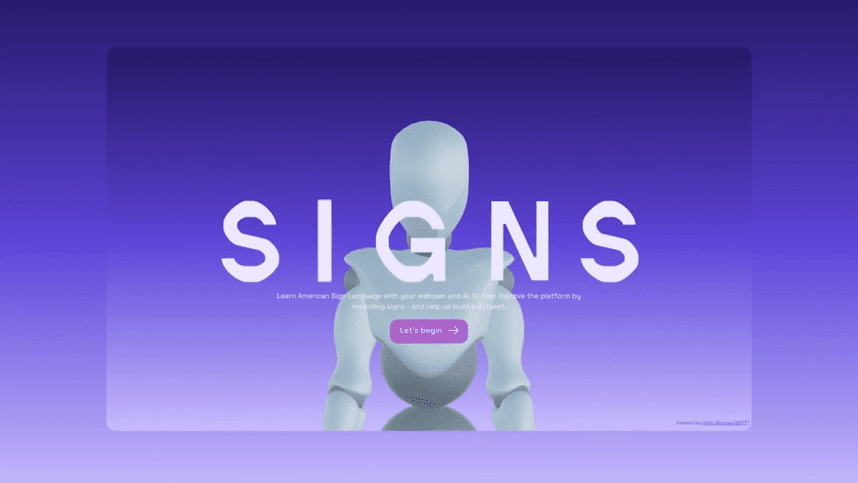

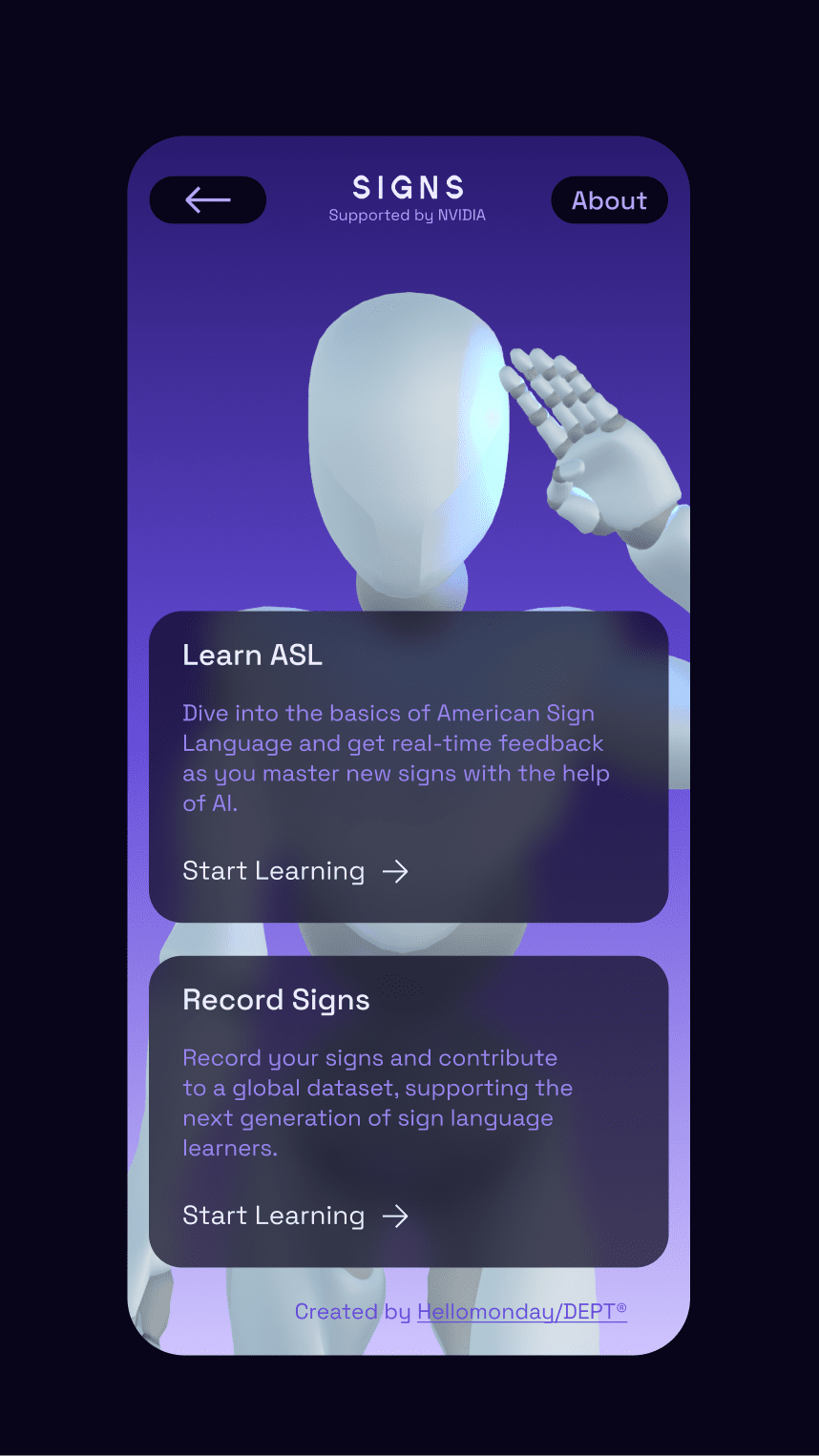

En colaboración con NVIDIA y la American Society for Deaf Children, creamos Signs, una plataforma de lengua de señas impulsada por IA, primera en su tipo, que hace que aprender ASL sea tan natural como una conversación.

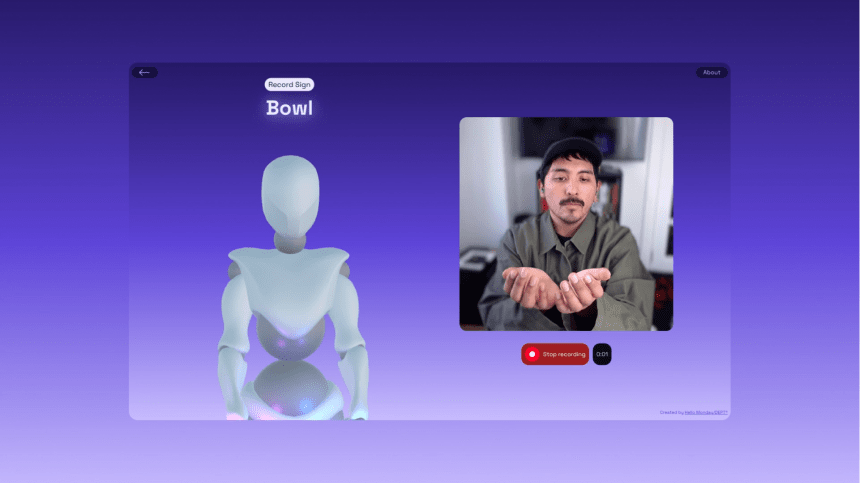

Utilizando IA de vanguardia, visión por computadora y aprendizaje automático, Signs transforma cualquier cámara en un entrenador interactivo de lengua de señas.

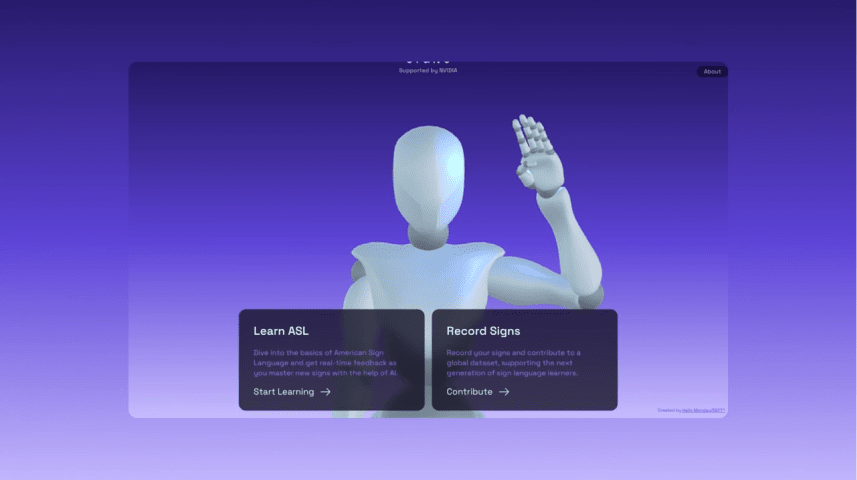

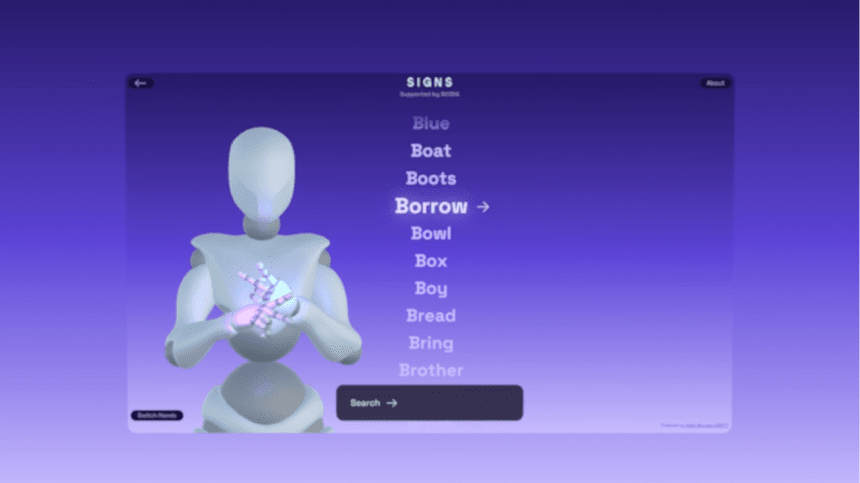

- Guía paso a paso: un avatar 3D demuestra cada seña desde múltiples ángulos.

- Feedback en tiempo real: la IA rastrea los movimientos de la mano de lxs usuarixs, proporcionando correcciones instantáneas.

- Una base de datos de ASL en crecimiento: lxs usuarixs contribuyen con videos de sí mismxs haciendo señas, ayudando a entrenar la IA y a construir un conjunto de datos de código abierto en constante expansión.

Por primera vez, lxs estudiantes no solo observan, sino que interactúan. Reciben feedback inmediato y personalizado. Practican con confianza, sabiendo que cada corrección lxs acerca más a la fluidez.

Y está funcionando.

El impacto

Signs se lanzó en un plan de zero paid media, y aun así, el mundo escuchó.

- Destacado en CNN, Axios, Venturebeat y en medios de comunicación globales.

- Un conjunto de datos en rápida expansión que impulsa el futuro del reconocimiento de lenguaje de señas impulsado por IA.

+1b

impresiones orgánicas

+20m

personas alcanzadas en la primera semana

+20,000

señas aprendidas en 10 días

Construyendo un movimiento global de IA

Signs no solo está enseñando ASL, sino que está dando forma al futuro de la accesibilidad impulsada por IA:

- Más de 400.000 videoclips y más de 1.000 señas en desarrollo

- Entrenamiento continuo de la IA, refinando el reconocimiento de movimientos y expresiones de señas complejas

- Un conjunto de datos puesto a disposición del público por NVIDIA, que permite a investigadorxs y desarrolladorxs construir la próxima generación de herramientas de accesibilidad impulsadas por IA, desde la traducción de lengua de señas en tiempo real en videoconferencias hasta un asistente de IA que comprende la lengua de señas.

Al abrir este conjunto de datos, Signs no solo está ayudando a lxs estudiantes individuales, sino que está impulsando un futuro donde la IA no solo reconoce la lengua de señas, sino que lo comprende.

Signs es gratuito, abierto a todxs y está en constante mejora.

- Aprende – Comienza a usar señas hoy en signs-ai.com

- Contribuye – Graba y sube señas para ayudar a expandir el conjunto de datos

- Comparte – Cuanta más gente use Signs, más inteligente se vuelve

“En última instancia, nuestro objetivo es conectar a familias, amistades y comunidades haciendo que el aprendizaje de ASL sea más accesible, al tiempo que se permite la creación de tecnologías de IA más inclusivas.

”Michael Boone, NVIDIA